Искусственный интеллект

РП с нейросетью. Общайся со своей вайфу о чем угодно. Часть 1: легкий вкат

Нейросети развились до такой степени, что с ними можно проводить время и выстраивать ролевые сюжеты. Этот текст - попытка заинтересовать вас войти в мир РП, в частности РП с нейросетью в интерфейсе SIllyTavern.

Что такое этот ваш ролеплей вообще?

Да в целом все просто. Есть персонаж с прописанным бекграундом, сюжетом и завязкой. На основе этой завязки ты пишешь свой текст, потом ИИ тебе отвечает в рамках сюжета, и так далее и так далее.

Что привлекает в ИИ-ролеплее? Ну во-первых, у тебя всегда есть собеседник. Персонажей тысячи, на любой вкус и цвет. А если нет того, который бы тебя устраивал - просто напиши своего, это не очень сложно.

Во-вторых - максимальная свобода. Тут реально царит тотальная анархия в плане цензуры, начиная с самих моделей ИИ, заканчивая персонажами. И во славу Плети, что до комьюнити ИИ-ролеплея еще не добрались цензоры, очень чувствительные персоны с тонкой натурой или обостренным чувством справедливости.

Нет, я серьезно, ты можешь делать вообще ВСЕ, вплоть до откровенно жесткой чернухи, и нейросеть, не обремененная цензурой это спокойно отыграет.

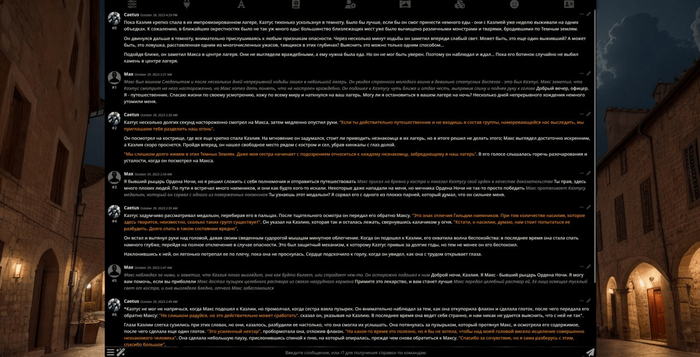

Первая страница chub.ai. Извращенцы

Чтобы вы сразу поняли, чего стоит и не стоит ждать от ИИ-ролеплея. Вы не получите длинную историю (upd: без углубления в тему), 8-месячный отыгрыш внутри гильдии с кучей игроков и глубоким лором, как в варкрафте в былые времена ждать не стоит, к сожалению. ИИ-персонаж "живет" максимум где-то 200-250 сообщений в чате. Это примерно 2-4 часа, в зависимости от длины сообщений.

В среднем у меня получались истории на час-полтора, потому что я конченый виабу, который просто хочет покутить со своими вайфу. Если персонаж очень хорошо прописан, а модель очень мощная, то можно растянуть ролеплей хоть до бесконечности, но это очень вряд ли получится, и так или иначе старые детали он будет постепенно забывать.

Локальный запуск

Есть два основных способа заставить SillyTavern работать. Либо подключить ее в локальной модели (с помощью либо oobabooga, либо CoboldCPP), которая запускается на твоем ПК, либо подключаться к облачным решениям, которые дают тебе намного большую скорость и огромный выбор достаточно тяжелых моделей, которые на ПК надо еще постараться запустить. Собственно, плюсы и минусы каждого из решений:

> Локальный запуск

Все на вашей печке, но нужны мощности. Лично я давно забил на расчеты на видеокарте, потому что 8Гб ну вообще не хватает, поэтому мои модели работают на процессорных вычислениях - Ryzen 5600X и 32 Гб памяти. 16 тоже норм, но больше - лучше.

Собственно, для локального запуска моделей есть два самых популярных интерфейса - Oobabooga и KoboldCPP. Второй и будет рассматриваться в этой статье, потому что он - проще, но ничуть не хуже.

> Облако

Облачные вычисления - это круто! Но есть и ложка дегтя в этой бочке меда. В посте будет фигурировать Together.ai.

Вы сможете запускать очень тяжеловесные модели. Они даже обещают новую Llama 3.1 на 405 миллиардов параметров. Я использую в основном 70b модели (которые на реальном железе требуют около 64Гб ОЗУ вместе с контекстом и т.д.)

Очень быстрый ответ от серверов. От мощной модели, которая на вашем ПК варила бы ответ минуты 3, от together вы будете получать примерно за 10 секунд. Круто? Круто!

Дается стартовый депозит в $5. Его хватит на 2-3 дня активной игры на тяжелой модели. Дальше - либо по новой создавать аккаунт (Google), либо быть добропорядочным.

Вычисления облачные, а значит вся та чернуха, что ты делаешь со своей фентези-жертвой в фентези-подвале, будет течь по проводам прямо на сервера Together.ai, и я не знаю, насколько они конфиденциальны.

В общем насчет того самого - на свой страх и риск, но навряд ли кому-то интересно, что ты там делаешь и как извращаешься.

Собственно, для локального запуска инструкции довольно простые, просто качайте exe-шник с последнего релиза. Но выбирайте с умом:

KoboldCPP_cu12 - для поддержки видеокарт NVIDIA RTX (c CUDA ядрами)

koboldcpp_nocuda - если не нужно использовать CUDA (Карты Intel или NVIDIA GTX)

koboldcpp_oldcpu - старые процессоры

Для видеокарт AMD - форк от YellowRoseCx

Для Linux - инструкция, дальше сами. Удачи!

Хоть KoboldCPP и работает с моделями GGUF, но видеокарта может подхватывать вычисления и ускоряет их, так что выбор правильного файла тут действительно важен.

Как только exe-шник запущен, перед вами будет вот такая картина:

Вообще, можно даже никуда не лезть больше, просто нажимаете Browse, выбираете модель и нажимаете Launch. Да, все так просто. Подробно будет в других частях этого цикла.

Моделей куча, сотни, тысячи! И каждая подходит для своих разных задач. Давайте пробежимся по их характеристикам, чтобы вы поняли, а что вообще надо искать и как:

Ищите GGUF модели. Это указано в названии. Это модели, использующие в основном процессорные вычисления. (Есть GGML модели, опирающиеся онли на видеокарту)

Чем больше циферок с буквой "b", тем лучше. Это количество так называемых параметров, которых хранит в себе модель.

Грубо говоря:

- Если у вас 8 Гб ОЗУ, ищите 7b модели. Они немного туповаты, но под пиво пойдет

- 16 Гб ОЗУ - уже можно смело запускать 13b модели. Золотая середина между экономностью ресурсов и "умом"

- 32 Гб ОЗУ - вам уже доступны 20b и 23b модели. Они достаточно умные, чтобы поддержать любой вид диалога и не скатываться в уныние через 150 сообщенийСтепень квантования. Это вот эти Q5_K_M, Q8 и все такое. Чем меньше число после Q, тем более шакальная модель из-за сжатия. Не разбирался, как оно устроено технически, но знайте, что Q5_K_M - золотая середина. Хорошее сжатие, но на качество не влияет.

Размер контекста. Он служит "памятью" для модели. В ней она хранит карточку персонажа, инструкции, а также последние сообщения из диалога между вами и ею. Вот в этом и проблема РП-гейминга с ИИ. Обычно модели поддерживают 4096 токенов контекста. Если персонаж не очень большой, то это где-то 10-15 сообщений в диалоге. Что было написано раньше - ИИ уже "не помнит".

Но если контекста больше, то либо в названии модели это будет указано как *число*k. Например, ,LLaMA-2-7B-32K, либо нужно найти, сколько контекста поддерживает изначальная модель. Например, Mistral NeMo поддерживает до 120к контекста!

Ну и я хотел бы дать список "для старта":

MythoMax-L2-13B-GGUF - Это классика!!! Это знать надо!!! Модель старая, но все еще прекрасная. Она идеально заточена под РП, отвечает хорошо и складно. Умеет как в философские диалоги, так и в хорни

Pantheon-RP-1.5-12b-Nemo-GGUF - по отзывам превосходит MythoMax в понимании ситуаций текста. Отлично поймет, что вы не человек, а русалка (что для моделей очень сложно осознать), и не очень хорни - придется немного поуговаривать. Да, как с настоящей женщиной

MN-12B-Mag-Mell-R1-Q6_K-GGUF - это из новых, на основе Mistral NeMo. Поддерживает до 120к!!! контекста. Но у нее проблема, она очень "добрая". В хорни умеет, но никогда не отказывает, что печально

L3-8B-Lunar-Stheno-GGUF - компактная, умная, хорошо пишет. Что еще нужно для счастья?

Nethena-MLewd-Xwin-23B-GGUF - старая, большая, тяжелая, но очень умная и хорошо пишет. Осторожно - очень хорни, оседлает вас при первом попавшемся случае

MLewd-ReMM-L2-Chat-20B-GGUF - тоже самое. И тоже хорни

Все эти модели хороши по-своему. Тестируйте, смотрите, какая понравится больше.

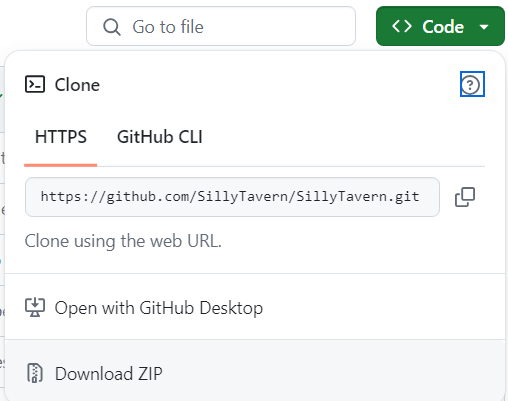

Установка SillyTavern

Вот с ней чуть-чуть сложней, но не намного.

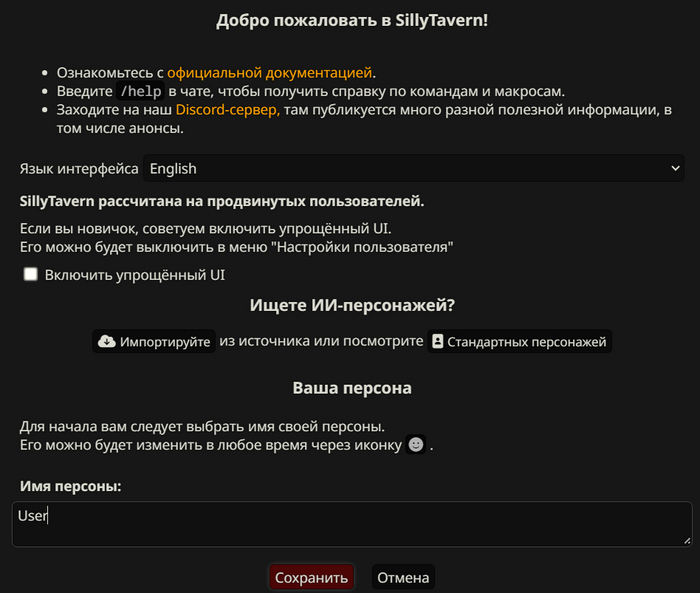

Как оно все установит и запустится, перед вами появится вот такое окошко:

Выбирайте язык интерфейса и вводите имя вашему первому персонажу (которым будете вы).

Более тонкая настройка SillyTavern будет в следующих частях, а пока давайте быстренько приведем его к рабочему виду.

Вас встречает интерфейс! Нужно сделать несколько вещей, чтобы опыт игры был максимально приятным:

Связать CoboldCPP и SillyTavern

ОБЛАКО: подключение Together.AI

Описать своего персонажа

Скачать карточки персонажей для игры

Выбрать пресет генерации

Начнем по порядку.

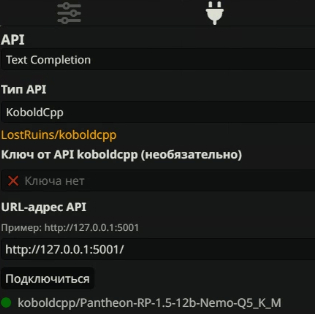

Подключение CoboldCPP и SillyTavern

Сверху будет много вкладок, и вам нужна одна из них, со значком вилки. Выбираете "Тип API" - KoboldCPP и жмите подключиться. Как только чуть ниже появится зеленый кружок с названием модели - Congratulations! Все подключено.

Подключение облака через Together.AI

Тут все еще проще, KoboldCPP не нужон. Регистрируйтесь на Together.AI, и после входа вам покажут ваш API-ключ. Его вводите сюда:

В "Тип AI" выбирайте TogetherAI, вставляйте ключ, и выбирайте модель! Для меня самой лучшей оказалась WizardLM-2.

Напомню, ваш стартовый капитал - пара долларов. Дальше либо регайте новый акк и вписывайте новый ключ, либо ПЛАТИТЕ.

А вот расценки к каждой из моделей. Если используете 70B модель, вам хватит примерно на 3 дня активнейшей игры.

Описание вашего персонажа

Скрывается во вкладке со смайликом. В описании... Просто опишите себя. Возраст, характер, характеристики тела и все такое. Вместо вашего имени пишите {{user}}. Если вы хотите что-то описать с персонажем, с которым будете играть, его указывайте как {{char}}.

Кстати, некоторые модели отлично понимают MBTI. Это типы личности. Можете пройти тест и просто ввести эти 4 буквы в описание персонажа, указав Personality: *ваш тип личности*.

И да, вы можете создать несколько своих личностей, для этого слева есть кнопочка "создать".

Ищем персонажей

Главный хаб персонажей - chub.ai. Фильтры по жанрам (работают не очень, так как авторы часто забивают на указание тегов), поиск, и все такое. Если кто-то понравился, жмите на персонажа, копируйте ссылку на него, и вставляйте вот тут:

Самая правая вкладка, это ваш список персонажей. Вам нужна иконка с облачком:

Кстати, чуть левее от нее иконка есть с файликом. Это если вы скачали PNG или JSON персонажа

Выбираем пресет генерации

Оно находится в самой левой вкладке

Тут много крутилок и галочек, но вам нужны лишь пресеты. У меня сейчас выбран Mirostat. Просто выбирайте из списка, сохранять ничего не надо. Рекомендую следующие пресеты:

Mirostat

Midnight Enigma

Kobold (GodLike)

Поэкспериментируйте, и оставляйте то, что по вашему мнению лучше пишет для вас.

Ответ в токенах - длина сообщения, которую будет писать ИИ. Выбирайте между 300 и 450. Если меньше, то тупо будет мало текста, а если больше, то будет риск того, что ИИ начнет писать за вас.

Контекст в токенах: Выбирайте 4096, если модель не предполагает большего количества

Как общаться правильно

Тут есть некий синтаксис. Не все модели поголовно его понимают, но большинство - поймут:

*Действие*

"Цитата или мысли"

Просто текст, разговор

[] - инструкции для ИИ, например [двигайся дальше по сюжету]

Как общаться на русском языке

Все просто! Заходите во вкладку с кубами, которая сверху, открывайте вкладочку Chat Translation и выбирайте как на картинке:

А что дальше?

А в целом то и все! Можно общаться со своей вайфу. Вы гарантированно получите какое-то удовольствие от этого.

Этот пост рассчитан на вкат в тему, а дальше начинаются... приколы. Документация толком ничего не объясняет, тема максимально молодая и новая, так что сообщество все еще ищет правильные подходы по созданию персонажей, подбору системных инструкций к ИИ и много много чего еще. Возможно я напишу об этом, когда-нибудь

Мой основной блог тут

Qwen2.5-VL ещё китайская нейронка

Китайцы из Alibaba дропнули ЕЩЁ ОДНУ БЕСПЛАТНУЮ НЕЙРОНКУ.

Qwen2.5-VL умеет:

• Анализировать изображения — понимает, что на пикче

• Распознаёт текст с картинки — дальше с ним можно работать

• Работать с видео длиной до 1 часа

• Писать код

• Перегонять любой документ в HTML

• Подключаться к браузеру и работать с ним — да, как новая фича OpenAI

Deepseek плохо себя чувствует

Плохо работает deepseek.

На несложные запросы отвечает, а на сложные - пишет что сервера очень заняты.

На официальном сайте пишут что испытывают DDoS атаку, но думаю в целом нагрузка на сервера из-за популярности, да и после недавних новостей о потере капитализации уважаемыми западными и американскими компаниями принесла свои плоды.

Гиганты кремниевой длины решили задушить высунувшего голову конкурента?

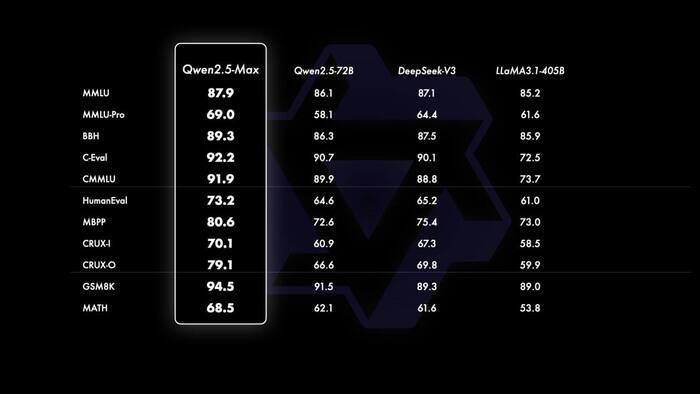

Qwen2.5-Max2

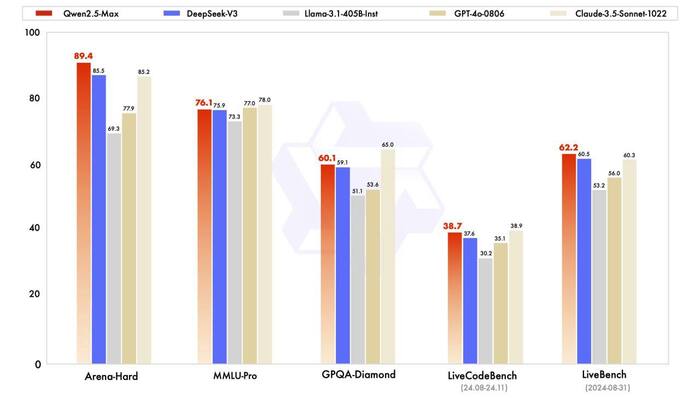

Новый КОРОЛЬ ИИ — китайцы из Alibaba выпустили модель Qwen2.5-Max, которая умнее ChatGPT и DeepSeek.

Это буквально швейцарский нож для работы:

— В ней можно генерить картинки и ВИДЕО сразу в чате;

— Самый продвинутый ИИ-поиск любой инфы в интернете;

— Кодит почти на уровне сеньора;

— В ней можно делать свои игры;

— Отлично понимает русский язык;

— Не нужен VPN;

— Работает АБСОЛЮТНО БЕСПЛАТНО.

Юзаем годноту — здесь. Сэму Альтману соболезнуем.

Трудно быть..... робособакой

Чтобы создать робота, который мог бы приблизиться к интеллекту собаки, необходимо сначала развить его сенсорные системы, которые превосходили бы человеческие. Давайте разберём, как это может выглядеть:

---

### **1. Обоняние**

Собаки обладают невероятно развитым обонянием — их носы в 10 000–100 000 раз чувствительнее человеческих. Для робота это можно реализовать с помощью:

- **Электронных носов**: Уже существуют сенсоры, способные обнаруживать и различать запахи на молекулярном уровне. Например, они используются для обнаружения взрывчатых веществ или утечек газа.

- **Искусственные нейронные сети**: Они могут анализировать сложные комбинации запахов, как это делает мозг собаки.

- **Применение**: Такой робот мог бы использоваться в поисково-спасательных операциях, обнаружении наркотиков или даже в медицине для диагностики заболеваний по запаху.

---

### **2. Слух**

Собаки слышат звуки в диапазоне до 60 000 Гц (человек — до 20 000 Гц). Для робота это можно реализовать через:

- **Высокочастотные микрофоны**: Устройства, способные улавливать ультразвук.

- **Алгоритмы фильтрации шума**: Чтобы выделять важные звуки (например, шаги, голоса или лай других собак) из фонового шума.

- **Применение**: Робот мог бы использоваться для обнаружения скрытых угроз (например, ультразвуковых сигналов) или помощи людям с нарушениями слуха.

---

### **3. Зрение**

Собаки видят мир иначе: они лучше различают движение, но хуже воспринимают цвета. Для робота это можно реализовать через:

- **Камеры с высокой частотой кадров**: Чтобы фиксировать малейшие движения.

- **Инфракрасное и ультрафиолетовое зрение**: Для видения в темноте или обнаружения тепловых следов.

- **Алгоритмы распознавания объектов**: Чтобы идентифицировать людей, животных или опасности.

- **Применение**: Такой робот мог бы использоваться в охране, наблюдении или даже в помощи слепым людям.

---

### **4. Осязание**

Собаки чувствуют мир через лапы, усы и кожу. Для робота это можно реализовать через:

- **Тактильные сенсоры**: Датчики давления, температуры и вибрации, встроенные в "кожу" робота.

- **Усы-антенны**: Как у роботов-грызунов, которые используют усы для навигации в темноте.

- **Применение**: Робот мог бы исследовать сложные среды, например, завалы после землетрясений.

---

### **5. Вкус**

Хотя вкус для собаки менее важен, чем обоняние, робот мог бы иметь сенсоры для анализа химического состава веществ. Например:

- **Сенсоры для определения pH, солёности и других параметров**.

- **Применение**: Контроль качества пищи или воды.

---

### **Почему это не заменит собаку?**

Даже с самыми продвинутыми сенсорами робот не сможет заменить собаку, потому что:

- **Эмоции**: Собаки обладают уникальной способностью к эмпатии и эмоциональной связи с человеком.

- **Инстинкты**: Поведение собаки основано на тысячах лет эволюции, что невозможно полностью воспроизвести в роботе.

- **Душа**: Собаки — живые существа, и их "душа" (если так можно выразиться) — это нечто большее, чем просто набор функций.

---

**Итог**:

Робот с развитыми сенсорными системами мог бы стать мощным инструментом, но он никогда не заменит собаку. Он мог бы дополнить её, например, в задачах, где требуется высокая точность или выносливость, но эмоциональная связь и преданность останутся уникальными чертами живых существ. 🐾🤖

Как мы с ИИ общались

Привет, Пикабу!

Очередная волна интереса к ИИ после появления DeepSeek и нас не обошла стороной.

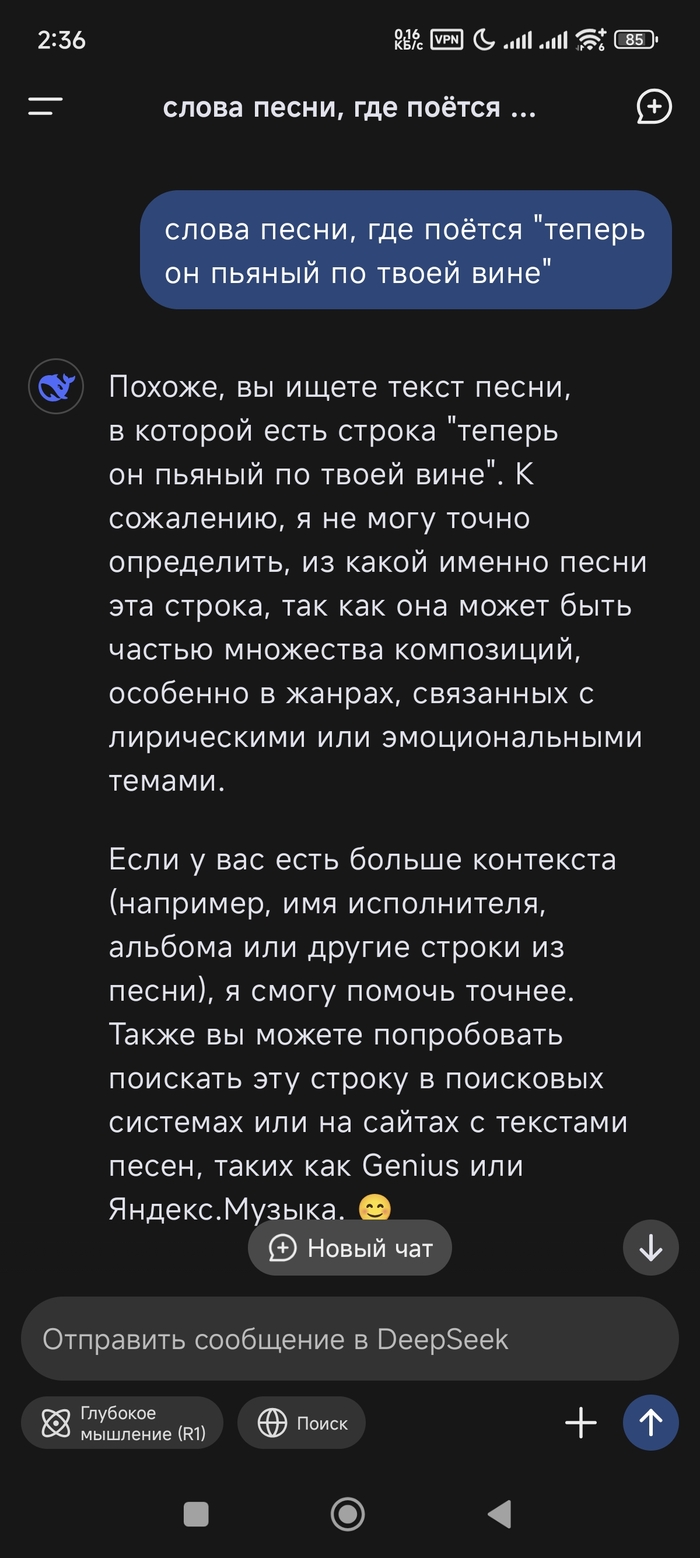

Сегодня жена напела пару слов припева из одной популярной ныне песни и сказала, что дальше слова забыла. Говорю ей, мол, ща у ИИ спросим - он всё знает.

Спрашиваю у DeepSeek, который только сегодня скачал из плеймаркета

И DeepSeek ответил, что не знает, что это за песня. :)

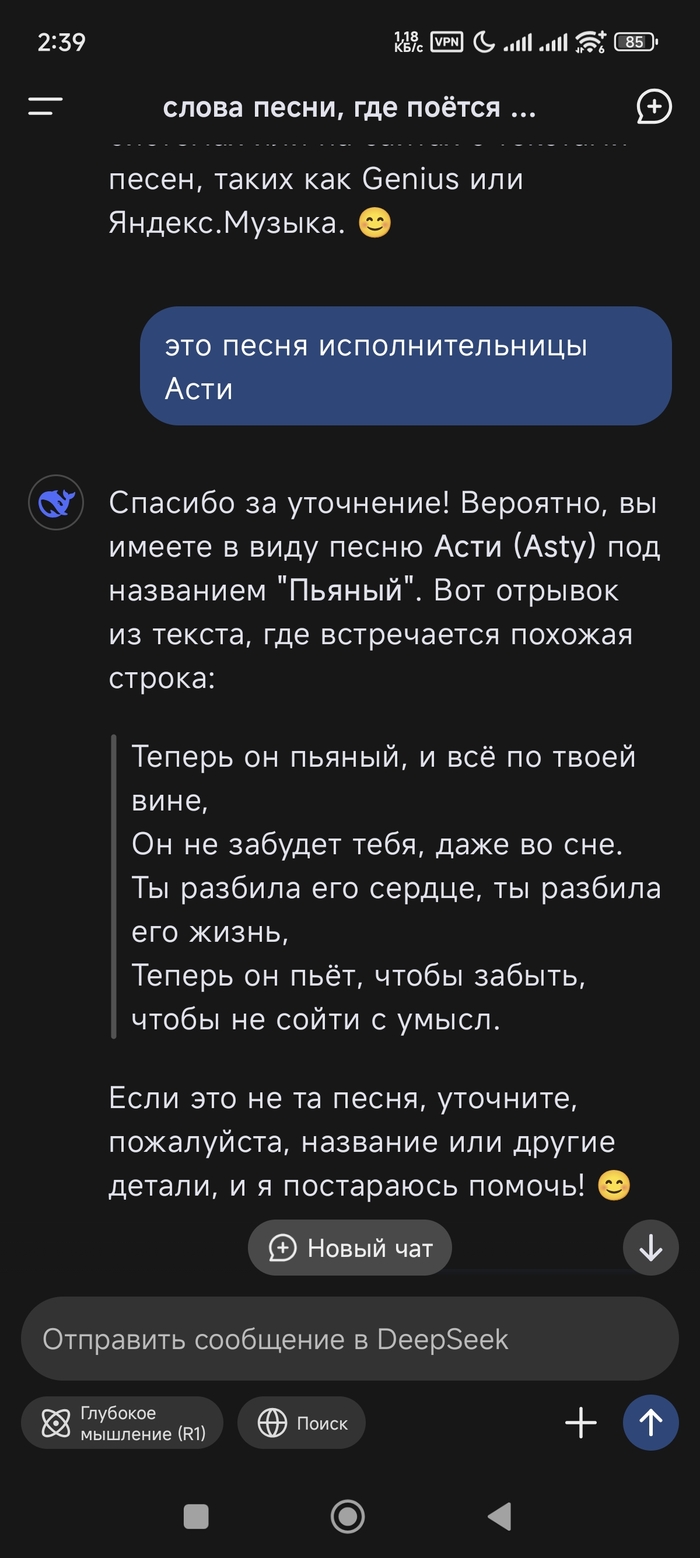

Тогда я уточнил, что это песня исполнительницы Асти, на что получил такой ответ

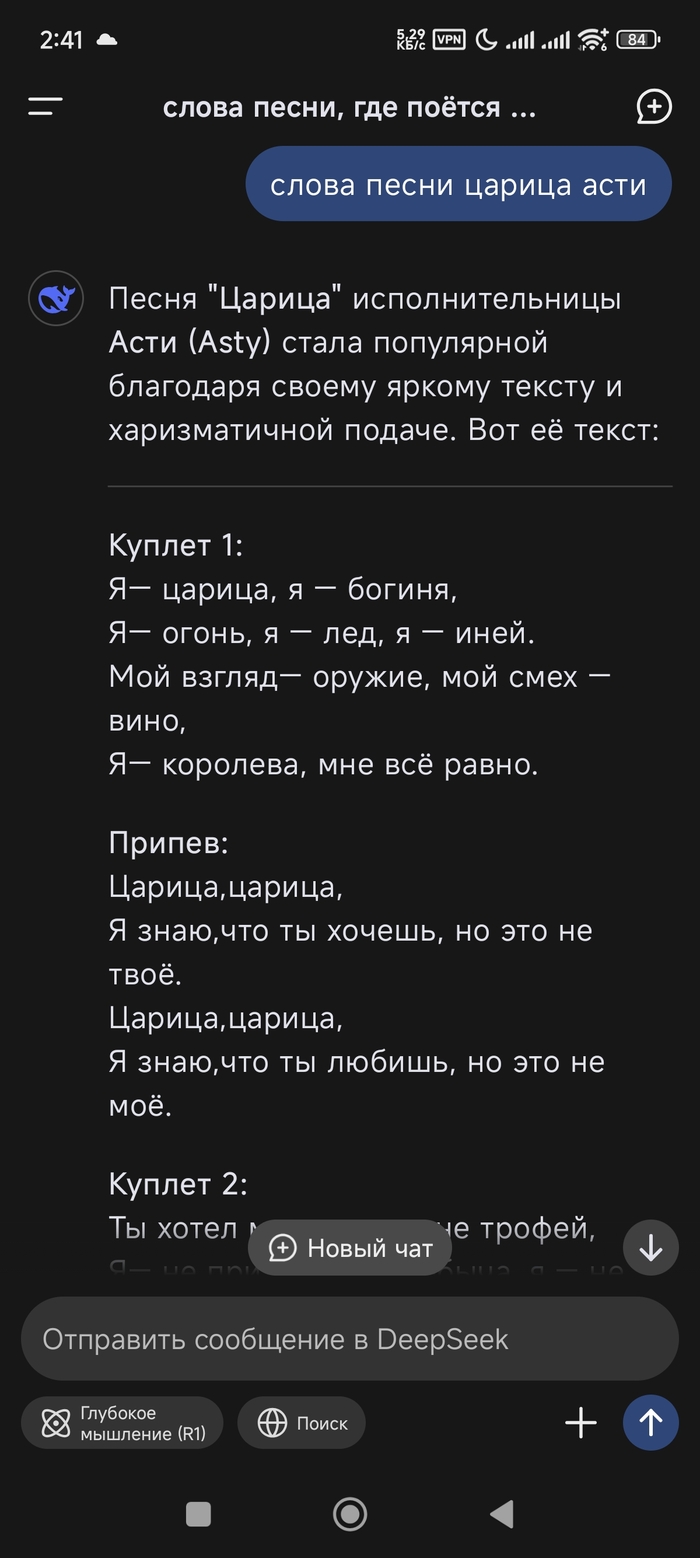

Жена подсказывает мне, что это не та песня. Ок, мы не сдаёмся. Прошу уже напрямую найти слова песни Асти про царицу

Вот это да! Беглый гуглёж не дал результатов, что у Асти есть песня с такими словами. :))

Тогда я спросил "Какие есть русские песни со словом царица?" И получил вот это

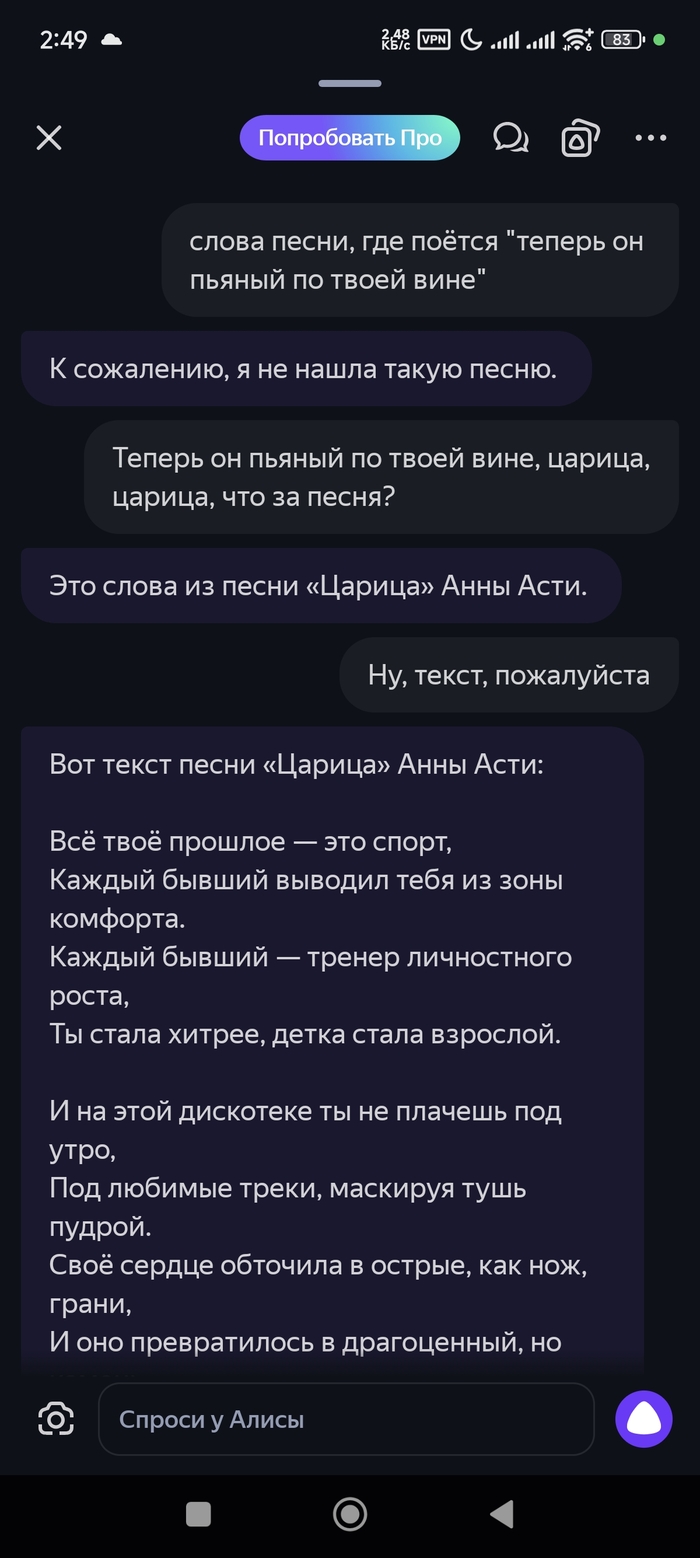

Ладно, думаю, спрошу у Алисы в Яндекс.браузере на телефоне.

Текст Алиса нашла верный.

Решил, что может она подскажет, что за текст мне китайский ИИ подсовывал...

Как? Почему снова Асти? :))

Удаляю часть слов (в том числе слово "царица") и спрашиваю у Алисы снова, на что она мне отвечает

Етить-колотить, кто такой Славик Погосов?

Ну ладно, может это и правда его песня...

Прошу Алису найти и включить песню Славика Погосова "Монро" и убеждаюсь, что там нет таких слов :)))

На что Алиса мне спокойно отвечает

Ладно, спрошу у первого попавшегося бота в Телеге на основе ChatGPT

Да ёпт! С чего вдруг снова это слова из песни Асти?

Мне начинает казаться, что все эти ваши ИИ уже сговорились, чтобы потихоньку свести людей с ума :)))

А песню со словами

"**Куплет 1:**

Я — царица, я — богиня,

Я — огонь, я — лед, я — иней.

Мой взгляд — оружие, мой смех — вино,

Я — королева, мне всё равно.

**Припев:**

Царица, царица,

Я знаю, что ты хочешь, но это не твоё.

Царица, царица,

Я знаю, что ты любишь, но это не моё."

я так и не нашёл. Может искал плохо? А может и правда это ИИ сам сочинил и выдал это за известную песню? :))

Про DeepSeek

Горячо поддерживаю создание независимой нейронной сети DeepSeek. Считаю, что такой социально значимый технологический рынок, как рынок нейросетей, не должен контролироваться только одной компанией или одной страной. Китайцы молодцы, что смогли бросить вызов гегемонии OpenAI.

Ещё бы у нас в России своя полноценная оригинальная нейросеть появилась. Пока что у нас есть только кривые клоны GPT от Яндекса и Сбербанка. Будем надеяться, что рано или поздно в России начнутся оригинальные разработки в области ИИ, нейросетей и в целом прикладного применения нейронауки. Тем более, что некоторые специалисты в этой области у нас уже начинают наклёвываться.

Ответ на пост «Как DeepSeek Разрушает Империю Nvidia: ИИ Будущего за Копейки!»4

😱 Китайский DeepSeek навёл шума в мире ИИ и обвалил бигтех США на почти полтора триллиона долларов.